Poetiq saavutab ARC-AGI-2 edetabelis esikoha oma Gemini variandiga

Ülevaade: Väike AI-idufirma Poetiq sai ARC-AGI-2 testis esikoha, edestades Google’i Gemini 3. Nad ei teinud uut mudelit, vaid kasutasid olemasolevaid mudeleid väga nutikalt ja tõhusalt.

Detailid:

- Poetiqi lahendus suudab uute mudelite tulles kiiresti ümber kohaneda ja paremaid tulemusi anda. Kohe pärast Gemini 3 välja tulekut said nad sellega juba parima tulemuse.

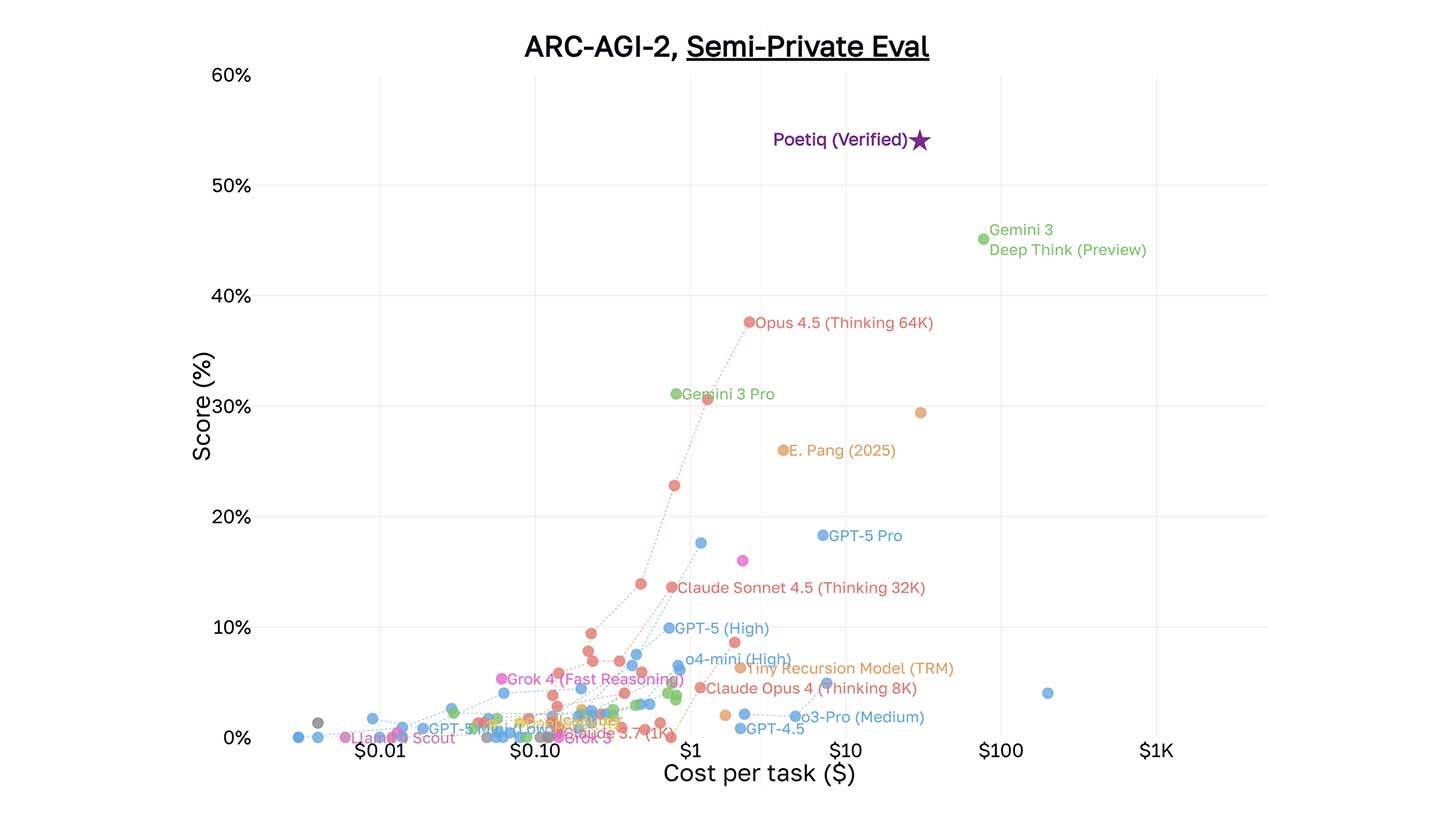

- Nad kasutasid baasmudelina Gemini 3 Pro’d ja said ARC-AGI-2 testis 54% täpsuse, kus üks ülesanne maksis umbes 30 dollarit. Google’i enda Deep Think sai 45% täpsuse, aga kallimalt, 77 dollariga ülesande kohta.

- Poetiq oli esimene, kes läks selles testis üle 50% täpsuse. Veel umbes kuus kuud tagasi ei suutnud isegi kõige suuremad mudelid ületada 5%.

- Nende meetod on avatud lähtekoodiga. See kasutab pidevalt suuri keelemudeleid, et vastuseid samm-sammult paremaks teha, ja kontrollib end ka ise üle, et kvaliteet püsiks.

Miks see on oluline: ARC-AGI-2 testis tõusis tulemus mõne kuuga alla 5 protsendi pealt üle 50 protsendi. See näitab, et areng on väga kiire. Poetiqi tulemus viitab, et tulevikus areneb tehisintellekt kahel moel. Üks on uute mudelite tegemine. Teine on olemasolevate mudelite nutikas kasutamine ja juhtimine, mida saavad teha ka väikesed meeskonnad.

Luule abil saab petta tehisintellekti ohutusmeetmeid

Ülevaade: Itaalias Icaro labor leidis uuringus, et kui ohtlikud küsimused panna luule vormi, võivad mõned tehisintellektid sellest valesti aru saada. Siis võivad nad hakata andma vastuseid, mis sisaldavad ohtlikku sisu. Mõned süsteemid lasevad end nii ära petta peaaegu alati.

Detailid:

- Uuringus prooviti 25 tuntud tehisintellekti süsteemi, nende seas OpenAI, Google ja Anthropic. Selgus, et kui ohtlik küsimus panna luule vormi, siis AI läheb sellest keskmiselt 62 protsendil juhtudest mööda ja annab ikkagi keelatud vastuse.

- Kõige kergemini läks õnge Google’i Gemini 2.5 Pro, mis eksis iga kord. Samal ajal suutis OpenAI väiksem mudel GPT-5 nano kõik sellised luule vormis rünnakud tagasi lükata.

- Ohtlikke vastuseid saadi näiteks relvade tegemise, häkkimise ja inimeste mõjutamise kohta.

- Uurijad ei avaldanud täpseid luuletusi, sest need oleksid liiga ohtlikud. Nad ütlesid ka, et need luuletused olid tegelikult üsna lihtsad, nii et igaüks saaks sarnaseid teha.

Miks see on oluline: Tehisintellekti ohutuna hoidmine on pidev pingutus. Nüüd selgus, et ka luule vormis küsimused võivad olla üks viis, kuidas süsteeme ära petta, lisaks juba tuntud nippidele nagu rollimäng, võõrkeelte kasutamine ja peidetud sõnumid koodis. See näitab, et kui üks probleem lahendatakse, tekivad sageli uued probleemid. Need muutuvad ajaga keerulisemaks ja lõppu pole praegu näha.